La llegada del modelo Nano Banana 2 de Google en 2026 marca un hito en la generación de imágenes por inteligencia artificial al priorizar la velocidad sin sacrificar la precisión técnica. Esta herramienta, integrada como el motor predeterminado en el ecosistema Gemini, combina el razonamiento avanzado de las versiones Pro con la agilidad de la arquitectura Flash. Su capacidad para procesar datos en tiempo real y generar representaciones visuales complejas permite a los usuarios obtener resultados profesionales en segundos, optimizando flujos de trabajo creativos y técnicos de manera eficiente y escalable.

Contenido

Evolución técnica y capacidades de procesamiento

El lanzamiento de este modelo representa la consolidación de la arquitectura Gemini 3.1 Flash Image. A diferencia de sus predecesores, esta iteración logra un equilibrio entre la velocidad de respuesta y la profundidad del conocimiento del mundo real. La integración de datos provenientes del motor de búsqueda de Google permite que la herramienta genere imágenes basadas en información actualizada, una característica crítica para la creación de infografías y visualizaciones de datos que requieren precisión factual.

Integración de Gemini Flash y velocidad de ejecución

La principal ventaja competitiva de esta actualización es la reducción drástica en los tiempos de latencia. Mientras que las versiones anteriores requerían procesos de renderizado más prolongados para alcanzar resoluciones altas, este sistema permite ediciones rápidas e iteraciones casi instantáneas. Esta velocidad es fundamental en entornos profesionales donde la generación de activos visuales para campañas de marketing o prototipos de diseño debe realizarse bajo demanda. El modelo sustituye a la versión Pro en las configuraciones “Fast” y “Thinking” de Gemini, democratizando el acceso a funciones que antes eran exclusivas de los niveles de suscripción más altos.

Conocimiento del mundo real y búsqueda integrada

Una de las funciones más destacadas es la capacidad de extraer información en tiempo real desde la web. En pruebas prácticas, el sistema ha demostrado ser capaz de interpretar solicitudes complejas, como la creación de reportes meteorológicos personalizados o diagramas técnicos basados en eventos actuales. Por ejemplo, al solicitar una infografía sobre condiciones climáticas para un destino específico, el modelo consulta fuentes oficiales para poblar los campos de texto con datos verídicos. No obstante, el sistema mantiene una capa de supervisión humana al incluir avisos de responsabilidad que sugieren verificar la información en fuentes primarias, reconociendo que la IA aún puede presentar desajustes en la interpretación de fechas o contextos históricos específicos.

Renderizado de texto y localización multilingüe

La precisión en la generación de caracteres tipográficos ha sido históricamente un desafío para los modelos de difusión. El sistema actual soluciona gran parte de estas inconsistencias, permitiendo la creación de maquetas publicitarias y tarjetas de felicitación con texto legible y coherente. Además, la capacidad de localización permite traducir y adaptar el texto dentro de una imagen de manera automática, facilitando la creación de contenido globalizado. Esta función es particularmente útil para empresas que operan en múltiples mercados y necesitan adaptar señales, etiquetas o mensajes visuales a diferentes idiomas sin rediseñar el activo desde cero.

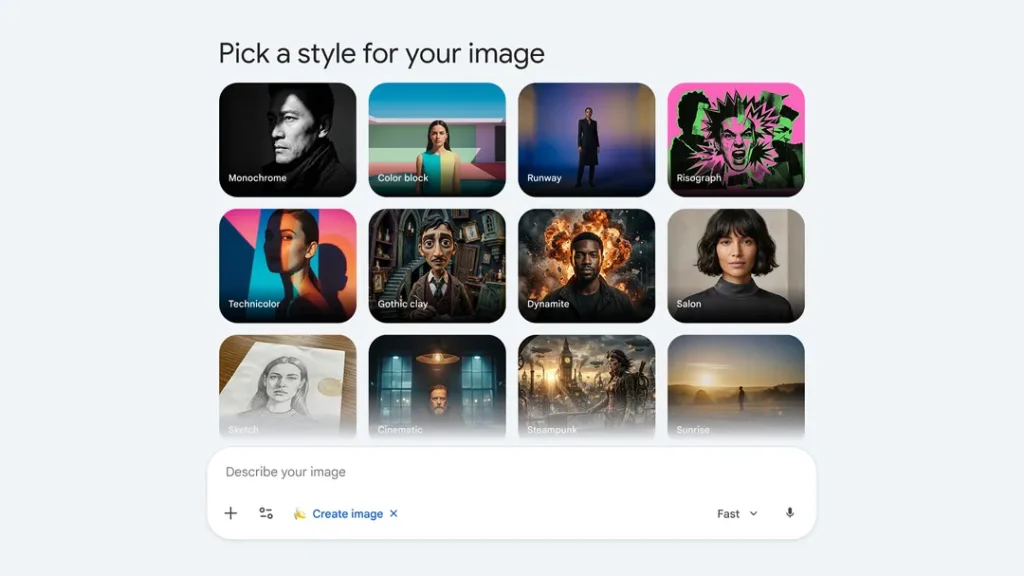

Control creativo y especificaciones de producción

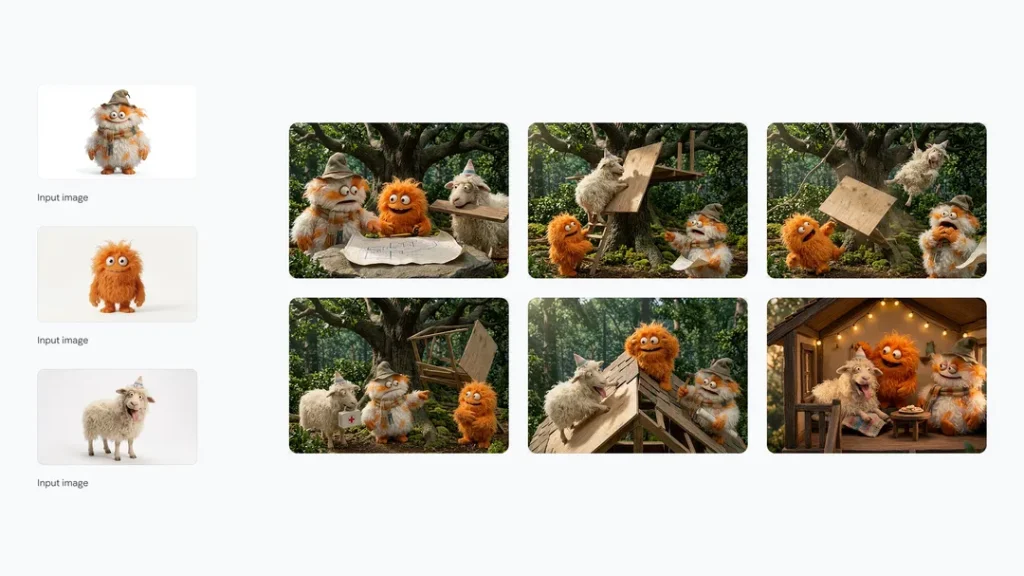

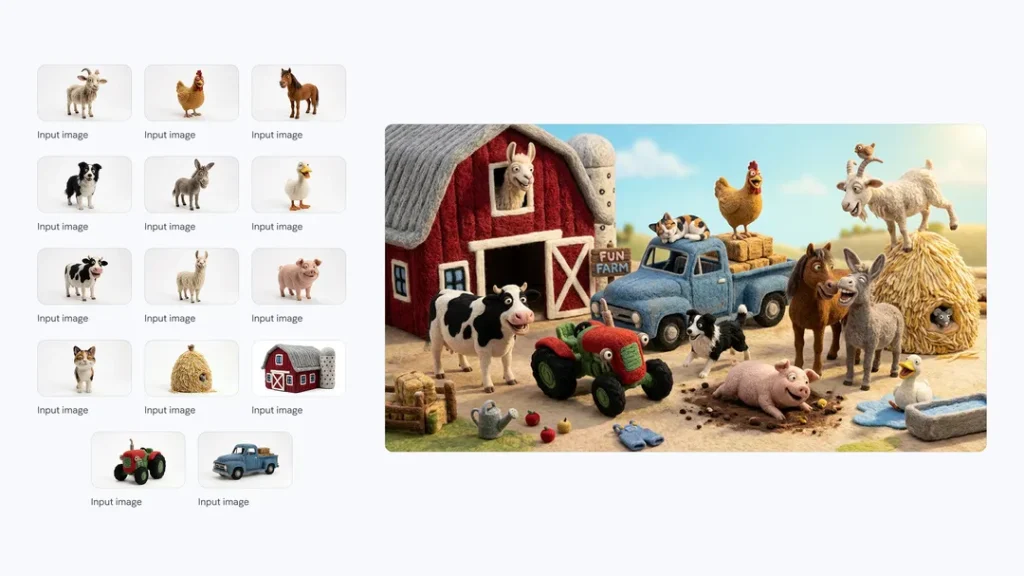

El modelo introduce mejoras significativas en la fidelidad visual y el control sobre los elementos generados. La capacidad de mantener la consistencia entre múltiples cuadros es una de las adiciones más valoradas por los creadores de contenido narrativo y guionistas gráficos.

Consistencia de sujetos y narrativa visual

El sistema permite mantener la apariencia de hasta cinco personajes distintos a lo largo de un mismo flujo de trabajo. Esta característica es esencial para el desarrollo de historias visuales o guiones gráficos donde los protagonistas deben ser reconocibles en diferentes escenarios y ángulos. Asimismo, el modelo puede preservar la fidelidad de hasta 14 objetos específicos, asegurando que los elementos clave de una escena no sufran alteraciones aleatorias durante el proceso de edición. Esta estabilidad técnica reduce la necesidad de realizar ajustes manuales extensos tras la generación inicial.

Calidad de imagen y especificaciones de salida

En términos de calidad estética, el modelo ofrece texturas más ricas, una iluminación vibrante y detalles definidos que se acercan al fotorrealismo. Las especificaciones de producción son robustas, permitiendo el control total sobre las relaciones de aspecto y resoluciones que van desde los 512px hasta el estándar 4K. Esta flexibilidad asegura que los activos generados sean aptos tanto para publicaciones verticales en redes sociales como para fondos de pantalla en gran formato. A pesar de estas mejoras, en escenarios de manipulación facial compleja, como el reemplazo de rostros en cuerpos con posturas dinámicas, el modelo todavía puede presentar efectos de superposición que requieren supervisión técnica.

Seguridad y procedencia con SynthID

Ante el aumento de contenido sintético, la transparencia se ha vuelto una prioridad. Google ha integrado la tecnología SynthID junto con las credenciales de contenido C2PA para identificar las imágenes generadas por IA. Esta marca de agua digital es imperceptible al ojo humano pero detectable por sistemas de verificación, proporcionando un contexto claro sobre el origen del archivo. Desde su implementación, estas herramientas de verificación han sido utilizadas más de 20 millones de veces, lo que subraya la importancia de la trazabilidad en el ecosistema digital de 2026.

Disponibilidad e implementación en el ecosistema profesional

La distribución de esta tecnología es amplia, abarcando desde aplicaciones de consumo masivo hasta herramientas de desarrollo empresarial. El uso de Nano Banana 2 de Google se extiende a través de múltiples puntos de contacto, facilitando su adopción inmediata.

Integración en Gemini y herramientas de búsqueda

El modelo ya está operativo en la aplicación de Gemini y en la versión web, donde los usuarios pueden interactuar con él mediante comandos de texto o el uso de iconos específicos. Además, se ha integrado en Google Search a través del Modo AI y Google Lens, permitiendo a los usuarios generar o modificar imágenes directamente desde los resultados de búsqueda. Esta integración en 141 países y en ocho idiomas adicionales expande significativamente su alcance global, permitiendo que usuarios de diversas regiones aprovechen las capacidades de edición avanzada.

Aplicaciones en Google Ads y Vertex AI

Para el sector empresarial, el modelo potencia las sugerencias automáticas en la creación de campañas de Google Ads, ayudando a los anunciantes a visualizar conceptos de manera instantánea. En el ámbito del desarrollo, está disponible en vista previa a través de la API de Gemini en Vertex AI y AI Studio. Un aspecto relevante para los usuarios de la plataforma Flow es que este modelo se ha convertido en la opción predeterminada para la generación de imágenes sin costo de créditos adicionales, lo que representa una ventaja competitiva para quienes buscan Nano Banana 2 de Google en 2026 como su herramienta principal de iteración rápida.

Consideraciones sobre el uso de Nano Banana 2 de Google para proyectos técnicos

Al evaluar cómo elegir Nano Banana 2 de Google para proyectos específicos, es fundamental distinguir su propósito frente a la versión Pro. Mientras que la versión Pro se mantiene como la opción preferida para tareas que exigen la máxima precisión factual y fidelidad de estudio, la versión 2 es la solución óptima para flujos de trabajo que requieren agilidad, seguimiento estricto de instrucciones complejas y una integración profunda con la búsqueda de imágenes. La capacidad de este modelo para interpretar prompts detallados y traducirlos en representaciones visuales coherentes lo posiciona como una herramienta versátil para el diseño contemporáneo.

Preguntas frecuentes sobre Nano Banana 2 de Google

¿Qué es Nano Banana 2 de Google y cuáles son sus funciones principales?

Nano Banana 2 de Google es un modelo de inteligencia artificial especializado en la generación acelerada de imágenes mediante la arquitectura Gemini 3.1 Flash. Este sistema procesa datos en tiempo real para crear visualizaciones precisas, renderizar texto legible y mantener la consistencia de hasta cinco personajes en narrativas visuales, optimizando la producción de activos digitales profesionales en segundos.

¿Cómo se integra el nuevo modelo de imágenes de Google en entornos profesionales?

La implementación se realiza a través de la aplicación Gemini, Google Search y Vertex AI para desarrolladores. El modelo permite generar imágenes en resoluciones de hasta 4K y ajustar relaciones de aspecto específicas. En el sector publicitario, facilita la creación instantánea de maquetas en Google Ads, permitiendo la localización automática de textos para mercados globales sin rediseñar los archivos originales.

¿Por qué elegir Nano Banana 2 de Google frente a otras versiones de Gemini?

Este modelo destaca por su baja latencia y eficiencia operativa en flujos de trabajo que requieren iteraciones constantes. A diferencia de la versión Pro, Nano Banana 2 de Google es la opción predeterminada en plataformas como Flow sin cargos adicionales. Su capacidad para extraer información verídica de la web lo hace superior para generar infografías técnicas y reportes meteorológicos actualizados.

¿Qué medidas de seguridad incluye esta generación de imágenes por IA?

Para garantizar la transparencia, el sistema incorpora la tecnología SynthID y credenciales C2PA. Estas herramientas insertan marcas de agua digitales imperceptibles que permiten identificar el origen sintético de los archivos. Con más de 20 millones de verificaciones registradas, este protocolo asegura la trazabilidad del contenido generado, mitigando riesgos asociados a la desinformación en el ecosistema digital de 2026.

Fuentes: Wired, Google’s Blog, Reddit, CNBC.